Теория вероятности и математическая статистика. Теория вероятностей

Математика включает целое множество областей, одной из которых, наряду с алгеброй и геометрией, является теория вероятности. Существуют термины, являющиеся общими для всех этих направлений, но, помимо них, есть и специфические, свойственные только одной конкретной «нише» слова, формулы, теоремы.

Словосочетание «теория вероятности» вызывает у неподготовленного студента панику. Действительно, воображение рисует картины, где фигурируют страшные объемные формулы, а решение одной задачи занимает целую тетрадь. Однако на практике всё вовсе не так ужасно: достаточно один раз понять смысл некоторых терминов и вникнуть в суть несколько своеобразной логики рассуждений, чтобы перестать бояться заданий раз и навсегда. В связи с этим мы рассмотрим основные понятия теории вероятностей и математической статистики - молодой, но крайне интересной области знаний.

Для чего учить понятия

Функция языка - передавать информацию от одного человека к другому так, чтобы он её понял, осознал и смог использовать. Каждое математическое понятие можно объяснить простыми словами, но в этом случае акт обмена данными занимал бы значительно больше времени. Представьте, что вместо слова «гипотенуза» вам всегда бы пришлось говорить «самая длинная сторона прямоугольного треугольника» - это крайне неудобно и долго.

Потому люди и придумывают новые термины для тех или иных явлений, процессов. Основные понятия теории вероятностей - событие, вероятность события и т. д. - появились точно так же. А значит, чтобы использовать формулы, решать задачи и применять навыки в жизни, необходимо не просто запомнить новые слова, но и понять, что означает каждое из них. Чем более глубоко вы осознаете их, вникаете в смысл, тем шире становятся рамки ваших возможностей, и тем полнее вы воспринимаете окружающий мир.

В чем смысл предмета

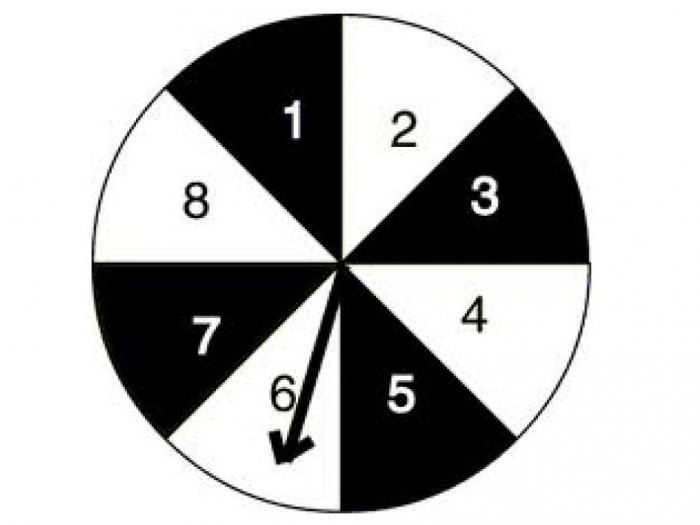

Познакомимся с основными понятиями теории вероятностей. Классическое определение вероятности звучит следующим образом: это отношение устраивающих исследователя исходов к общему числу возможных. Приведем простой пример: когда человек бросает кубик, тот может выпасть любой из шести сторон кверху. Таким образом, общее число исходов - шесть. Вероятность же того, что выпадет случайно выбранная сторона - 1/6.

Умение предсказывать появление того или иного результата является крайне важным для самых разных специалистов. Сколько бракованных деталей ожидается в партии? От этого зависит, сколько нужно произвести. Какова вероятность, что лекарство поможет побороть болезнь? Такая информация и вовсе является жизненно важной. Но не будем тратить время на дополнительные примеры и приступим к изучению новой для нас области.

Первое знакомство

Рассмотрим основные понятия теории вероятности и их использование. В праве, естественных науках, экономике представленные ниже формулы и термины используются повсеместно, поскольку имеют непосредственное отношение в статистике и погрешности измерений. Более подробное изучение этого вопроса откроет вам и новые формулы, полезные для более точных и сложных вычислений, однако начнем с простого.

Одним из самых базовых и основных понятий теории вероятностей и математической статистики является случайное событие. Объясним понятными словами: из всех возможных исходов эксперимента в результате наблюдается лишь один. Даже если вероятность наступления этого события значительно выше, чем другого, оно будет случайным, так как теоретически итог мог быть и иным.

Если мы провели серию экспериментов и получили некоторое количество исходов, то вероятность каждого из них рассчитывается по формуле: P(A) = m/n. Здесь m - это то, сколько раз в серии испытаний мы наблюдали появление интересующего нас результата. В свою очередь n - это общее количество проведенных экспериментов. Если мы бросили монетку 10 раз и 5 раз получили «решку», то m=5, а n=10.

Виды событий

Случается, что некоторый исход гарантированно наблюдается в каждом испытании - такое событие будет называться достоверным. Если оно не будет происходить никогда, то будет называться невозможным. Впрочем, такие события не используются в условиях задач по теории вероятности. Основные понятия, которые знать гораздо важнее - это совместные и несовместные события.

Случается, что при проведении эксперимента одновременно происходит сразу два события. Например, мы бросаем два кубика - в данном случае то, что на одном выпало «шесть», не гарантирует того, что на втором не выпадет другая цифра. Такие события будут называться совместными.

Если мы кидаем один кубик, то две цифры одновременно выпасть не смогут никогда. В данном случае исходы в виде выпавшей «единицы», «двойки» и т. д. будут рассматриваться как несовместные события. Очень важно различать, какие исходы имеют место в каждом конкретном случае - от этого зависит, какие формулы применять в задаче на нахождение вероятностей. Основные понятия теории вероятностей мы продолжим изучать спустя несколько абзацев, когда рассмотрим особенности сложения и умножения. Ведь без них ни одну задачу решить не удастся.

Сумма и произведение

Допустим, вы с другом бросаете кубик, и у него выпало «четыре». Вам, чтобы победить, необходимо получить «пять» или «шесть». В этом случае вероятности будут суммироваться: поскольку шансы выпадения обоих чисел равны 1/6, ответ будет выглядеть как 1/6 + 1/6 = 1/3.

А теперь представьте, что вы бросаете кубик по два раза, и ваш друг получил 11 очков. Теперь вам необходимо, чтобы два раза подряд выпало «шесть». События независимы друг от друга, поэтому вероятности понадобится перемножить: 1/6 * 1/6 = 1/36.

Среди основных понятий и теорем теории вероятностей следует обратить внимание на сумму вероятностей совместных событий, т. е. тех, которые могут происходить одновременно. Формула сложения в этом случае будет выглядеть так: P(A+B) = P(A) + P(B) - P(AB).

Комбинаторика

Очень часто нам требуется найти все возможные сочетания некоторых параметров объекта или вычислить количество каких-либо комбинаций (например, при подборе шифра). В этом нам поможет комбинаторика, теснейшим образом связанная с теорией вероятности. Основные понятия здесь включают некоторые новые слова, а ряд формул из этой темы вам наверняка пригодится.

Допустим, у вас есть три цифры: 1, 2, 3. Вам надо, используя их, написать все возможные трёхзначные числа. Сколько их будет? Ответ: n! (восклицательный знак означает факториал). Комбинации из некоторого количества разных элементов (цифр, букв и проч.), отличающиеся только порядком их расположения, называются перестановками.

Однако гораздо чаще мы сталкиваемся с такой ситуаций: имеется 10 цифр (от нуля до девяти), из которых составляется пароль или код. Предположим, его длина - 4 символа. Как рассчитать общее количество возможных кодов? Для этого существует специальная формула: (n!)/(n - m)!

Учитывая предложенное выше условие задачи, n=10, m=4. Далее требуются только простые математические расчёты. Кстати, называться такие комбинации будут размещением.

Наконец, существует понятие сочетаний - это последовательности, отличающиеся друг от друга хотя бы одним элементом. Высчитывается их число по формуле: (n!) / (m!(n-m)!).

Математическое ожидание

Важным понятием, с которым сталкивается студент уже на первых занятиях по предмету, является математическое ожидание. Оно представляет собой сумму всех возможных результирующих значений, помноженных на их вероятности. По сути, это среднее число, которое мы можем предсказать в качестве результата испытания. Например, есть три значения, для которых в скобках указаны вероятности: 0 (0,2); 1 (0,5); 2 (0,3). Посчитаем математическое ожидание: M(X) = 0*0,2 + 1*0,5 + 2*0,3 = 1,1. Таким образом, из предложенного выражения можно увидеть, что данная величина является постоянной и не зависит от исхода испытания.

Это понятие используется во многих формулах, и вы неоднократно с ним столкнетесь в дальнейшем. Работать с ним несложно: математическое ожидание суммы равно сумме мат. ожиданий - M(X+Y) = M(X) + M(Y). То же касается и произведения: M(XY) = M(X) * M(Y).

Дисперсия

Должно быть, со школьного курса физики вы помните, что дисперсия - это рассеяние. Каково её место среди основных понятий теории вероятностей?

Посмотрите на два примера. В одном случае нам дано: 10(0,2); 20(0,6); 30(0,2). В другом - 0(0,2); 20(0,6); 40(0,2). Математическое ожидание в обоих случаях будет одинаковое, как же тогда сравнивать эти ситуации? Ведь мы видим невооруженным глазом, что разброс значений во втором случае значительно больше.

Для этого и было введено понятие дисперсии. Чтобы получить её, необходимо рассчитать математическое ожидание от суммы разностей каждой случайной величины и математического ожидания. Возьмём числа из первого примера, записанного в предыдущем абзаце.

Сперва рассчитаем математическое ожидание: M(X) = 10*0,2 + 20*0,6 + 30*0,2 = 20. Тогда значение дисперсии: D(X) = 40.

Ещё одним из основных понятий статистики и теории вероятности является среднее квадратичное отклонение. Рассчитать его очень просто: нужно лишь взять корень квадратный из дисперсии.

Здесь же можно отметить такой простой термин, как размах. Это значение, обозначающее разницу между максимальным и минимальным значением в выборке.

Статистика

Некоторые базовые школьные понятия используются в науке очень часто. Двумя из них являются среднее арифметическое и медиана. Наверняка вы помните, как найти их значения. Но на всякий случай напомним: среднее арифметическое - это сумма всех значений, деленная на их количество. Если значений 10, то мы их складываем и делим на 10.

Медиана - это центральное значение в ряду всех возможных. Если мы имеем нечетное количество величин, то мы выписываем их в порядке возрастания и выбираем то, которое оказалось в середине. Если же у нас четное число значений, мы берем два центральных и делим на два.

Ещё два значения, располагающиеся между медианой и двумя крайними - максимальным и минимальным - значениями множества, именуются квартилями. Вычисляются они таким же образом - при нечетном количестве элементов берется число, располагающееся в середине ряда, а при четном - половина суммы двух центральных элементов.

Существует и специальный график, на котором можно увидеть все значения выборки, её размах, медиану, межквартальный интервал, а также выбросы - значения, не укладывающиеся в статистическую погрешность. Получающееся изображение носит весьма специфическое (и даже нематематическое) название - «ящик с усами».

Распределение

Распределение также относится к основным понятиям теории вероятности и математической статистики. Кратко говоря, оно представляет собой обобщенную информацию обо всех случайных величинах, которые мы можем увидеть в результате испытания. Главным параметром здесь будет вероятность появления каждого конкретного значения.

Нормальное распределение - это такое, которое имеет один центральный пик, в котором находится величина, встречающееся наиболее часто. От него дугами расходятся всё менее и менее вероятные исходы. В целом график со стороны похож на «горку». В дальнейшем вы узнаете, что с данным видом распределения теснейшим образом связана основополагающая для теории вероятности центральная предельная теорема. В ней описываются важные для рассматриваемого нами ответвления математики закономерности, очень полезные при разнообразных расчётах.

Но вернемся к теме. Существует ещё два вида распределений: ассиметричное и мультимодальное. Первое выглядит как половинка «нормального» графика, т. е. дуга спускается лишь в одну сторону от пиковой величины. Наконец, мультимодальное распределение - это такое, у которого существует несколько «верхних» значений. График, таким образом, то опускается, то поднимается. Наиболее частотное значение в любом распределении называется модой. Это также одно из основных понятий теории вероятностей и математической статистики.

Гауссово распределение

Гауссово, или нормальное, распределение - такое, в котором отклонение наблюдений от среднего подчиняется определенному закону.

Кратко говоря, основной разброс значений выборки экспоненциально стремится к моде - самому частотному из них. Ещё говорить точнее, то 99,6 % всех величин располагается в пределах трёх стандартных отклонений (помните, мы рассматривали это понятие выше?).

Гауссово распределение - одно из основных понятий теории вероятности. При помощи него можно понять, входит ли элемент по тем или иным параметрам в разряд «типичных» - так оценивается рост и вес человека в соответствии с возрастом, уровень интеллектуального развития, психологическое состояние и многое другое.

Как применить

Интересно, что «скучные» математические данные можно использовать с пользой для себя. Например, один молодой человек применил теорию вероятности и статистику, чтобы выиграть в рулетку несколько миллионов долларов. Правда, перед этим пришлось подготовиться - в течение нескольких месяцев записывать результаты игр в различных казино.

После проведения анализа он выяснил, что один из столов незначительно наклонен, а значит, ряд значений появляется статистически значимо чаще других. Немного расчётов, терпения - и вот владельцы заведения ломают головы, думая, как человеку может так повезти.

Есть целое множество повседневных бытовых задач, которые невозможно решить без обращения к статистике. Например, как определить, сколько магазину заказывать одежды разных размеров: S, M, L, XL? Для этого необходимо проанализировать, кто чаще покупает одежду в городе, в районе, в близлежащих магазинах. Если такую информацию не получить, владелец рискует потерять много денег.

Заключение

Мы рассмотрели целое множество основных понятий теории вероятностей: испытание, событие, перестановки и размещения, математическое ожидание и дисперсия, мода и нормальное распределение… Кроме того, мы рассмотрели ряд формул, на изучение которых в высшем учебном заведении отводится больше месяца занятий.

Не забывайте: математика необходима при изучении экономики, естественных наук, информационных технологий, инженерных специальностей. Статистику как одну из её областей здесь также нельзя обходить стороной.

Теперь дело за малым: практикуйтесь, решайте задачи и примеры. Даже основные понятия и определения теории вероятности забудутся, если не уделять время повторению. Кроме того, последующие формулы в значительной степени будут опираться на те, которые были нами рассмотрены. Поэтому постарайтесь их запомнить, тем более что их не так и много.

Многие, столкнувшись с понятием «теория вероятности», пугаются, думая, что это нечто непосильное, очень сложное. Но все на самом деле не так трагично. Сегодня мы рассмотрим основное понятие теории вероятности, научимся решать задачи на конкретных примерах.

Наука

Что же изучает такой раздел математики, как «теория вероятности»? Она отмечает закономерности и величин. Впервые данным вопросом заинтересовались ученые еще в восемнадцатом веке, когда изучали азартные игры. Основное понятие теории вероятности - событие. Это любой факт, который констатируется опытом или наблюдением. Но что же такое опыт? Еще одно основное понятие теории вероятности. Оно означает, что этот состав обстоятельств создан не случайно, а с определенной целью. Что касается наблюдения, то здесь исследователь сам не участвует в опыте, а просто является свидетелем данных событий, он никак не влияет на происходящее.

События

Мы узнали, что основное понятие теории вероятности - это событие, но не рассмотрели классификацию. Все они делятся на следующие категории:

- Достоверные.

- Невозможные.

- Случайные.

Независимо от того, какие это события, за которыми наблюдают или создают в ходе опыта, все они подвержены данной классификации. Предлагаем с каждым из видов познакомиться отдельно.

Достоверное событие

Это такое обстоятельство, перед которым сделан необходимый комплекс мероприятий. Для того чтобы лучше вникнуть в суть, лучше привести несколько примеров. Этому закону подчинены и физика, и химия, и экономика, и высшая математика. Теория вероятности включает такое важное понятие, как достоверное событие. Приведем примеры:

- Мы работаем и получаем вознаграждение в виде заработной платы.

- Сдали хорошо экзамены, прошли конкурс, за это получаем вознаграждение в виде поступления в учебное заведение.

- Мы вложили деньги в банк, при необходимости получим их назад.

Такие события являются достоверными. Если мы выполнили все необходимые условия, то обязательно получим ожидаемый результат.

Невозможные события

Сейчас мы рассматриваем элементы теории вероятности. Предлагаем перейти к пояснению следующего вида события, а именно - невозможного. Для начала оговорим самое важное правило - вероятность невозможного события равна нулю.

От данной формулировки нельзя отступать при решении задач. Для пояснения приведем примеры таких событий:

- Вода замерзла при температуре плюс десять (это невозможно).

- Отсутствие электроэнергии никак не влияет на производство (так же невозможно, как и в предыдущем примере).

Более примеров приводить не стоит, так как описанные выше очень ярко отражают суть данной категории. Невозможное событие никогда не произойдет во время опыта ни при каких обстоятельствах.

Случайные события

Изучая элементы особое внимание стоит уделить именно данному виду события. Именно их и изучает данная наука. В результате опыта может что-то произойти или нет. Кроме этого, испытание может проводиться неограниченное количество раз. Яркими примерами могут служить:

- Бросок монеты - это опыт, или испытание, выпадение орла - это событие.

- Вытягивание мячика из мешка вслепую - испытание, попался красный шар - это событие и так далее.

Таких примеров может быть неограниченное количество, но, в общем, суть должна быть понятна. Для обобщения и систематизирования полученных знаний о событиях приведена таблица. Теория вероятности изучает только последний вид из всех представленных.

название | определение | |

Достоверные | События, происходящие со стопроцентной гарантией при соблюдении некоторых условий. | Поступление в учебное заведение при хорошей сдаче вступительного экзамена. |

Невозможные | События, которые никогда не произойдут ни при каких условиях. | Идет снег при температуре воздуха плюс тридцать градусов по Цельсию. |

Случайные | Событие, которое может произойти или нет в ходе проведения опыта/испытания. | Попадание или промах при бросании баскетбольного мяча в кольцо. |

Законы

Теория вероятности - это наука, изучающая возможность выпадения какого-либо события. Как и другие, она имеет некоторые правила. Существуют следующие законы теории вероятности:

- Сходимость последовательностей случайных величин.

- Закон больших чисел.

При расчете возможности сложного можно использовать комплекс простых событий для достижения результата более легким и быстрым путем. Отметим, что законы теории вероятности легко доказываются с помощью некоторых теорем. Предлагаем для начала познакомиться с первым законом.

Сходимость последовательностей случайных величин

Отметим, что видов сходимости несколько:

- Последовательность случайных величин сходима по вероятности.

- Почти невозможное.

- Среднеквадратическая сходимость.

- Сходимость по распределению.

Так, с лету, очень тяжело вникнуть в суть. Приведем определения, которые помогут разобраться в данной теме. Для начала первый вид. Последовательность называют сходимой по вероятности , если соблюдено следующее условие: n стремится к бесконечности, число, к которому стремится последовательность, больше нуля и приближена к единице.

Переходим к следующему виду, почти наверное . Говорят, что последовательность сходится почти наверное к случайной величине при n, стремящейся к бесконечности, и Р, стремящейся к величине, приближенной к единице.

Следующий тип - это сходимость среднеквадратическая . При использовании СК-сходимости изучение векторных случайных процессов сводится к изучению их координатных случайных процессов.

Остался последний тип, давайте разберем кратко и его, чтобы переходить непосредственно к решению задач. Сходимость по распределению имеет и еще одно название - «слабое», далее поясним, почему. Слабая сходимость — это сходимость функций распределения во всех точках непрерывности предельной функции распределения.

Обязательно выполним обещание: слабая сходимость отличается от всех вышеперечисленных тем, что случайная величина не определена на вероятностном пространстве. Это возможно потому, что условие формируется исключительно с использованием функций распределения.

Закон больших чисел

Отличными помощниками при доказательстве данного закона станут теоремы теории вероятности, такие как:

- Неравенство Чебышева.

- Теорема Чебышева.

- Обобщенная теорема Чебышева.

- Теорема Маркова.

Если будем рассматривать все эти теоремы, то данный вопрос может затянуться на несколько десятков листов. У нас же основная задача - это применение теории вероятности на практике. Предлагаем вам прямо сейчас этим и заняться. Но перед этим рассмотрим аксиомы теории вероятностей, они будут основными помощниками при решении задач.

Аксиомы

С первой мы уже познакомились, когда говорили о невозможном событии. Давайте вспоминать: вероятность невозможного события равна нулю. Пример мы приводили очень яркий и запоминающийся: выпал снег при температуре воздуха тридцать градусов по Цельсию.

Вторая звучит следующим образом: достоверное событие происходит с вероятностью, равной единице. Теперь покажем, как это записать с помощью математического языка: Р(В)=1.

Третья: Случайное событие может произойти или нет, но возможность всегда варьируется в пределах от нуля до единицы. Чем ближе значение к единице, тем шансов больше; если значение приближается к нулю, вероятность очень мала. Запишем это математическим языком: 0<Р(С)<1.

Рассмотрим последнюю, четвертую аксиому, которая звучит так: вероятность суммы двух событий равняется сумме их вероятностей. Записываем математическим языком: Р(А+В)=Р(А)+Р(В).

Аксиомы теории вероятностей - это простейшие правила, которые не составит труда запомнить. Попробуем решить некоторые задачи, опираясь на уже полученные знания.

Лотерейный билет

Для начала рассмотрим простейший пример - лотерея. Представьте, что вы купили один лотерейный билет на удачу. Какова вероятность, что вы выиграете не менее двадцати рублей? Всего в тираже участвует тысяча билетов, один из которых имеет приз в пятьсот рублей, десять по сто рублей, пятьдесят по двадцать рублей, а сто - по пять. Задачи по теории вероятности основаны на том, чтобы найти возможность удачи. Сейчас вместе разберем решение выше представленного задания.

Если мы буквой А обозначим выигрыш в пятьсот рублей, то вероятность выпадения А будет равняться 0,001. Как мы это получили? Просто необходимо количество "счастливых" билетов разделить на общее их число (в данном случае: 1/1000).

В - это выигрыш в сто рублей, вероятность будет равняться 0,01. Сейчас мы действовали по тому же принципу, что и в прошлом действии (10/1000)

С - выигрыш равен двадцати рублям. Находим вероятность, она равняется 0,05.

Остальные билеты нас не интересуют, так как их призовой фонд меньше заданного в условии. Применим четвертую аксиому: Вероятность выиграть не менее двадцати рублей составляет Р(А)+Р(В)+Р(С). Буквой Р обозначается вероятность происхождения данного события, мы в предыдущих действиях уже их нашли. Осталось только сложить необходимые данные, в ответе мы получаем 0,061. Это число и будет являться ответом на вопрос задания.

Карточная колода

Задачи по теории вероятности бывают и более сложными, для примера возьмем следующее задание. Перед вами колода из тридцати шести карт. Ваша задача - вытянуть две карты подряд, не перемешивая стопку, первая и вторая карты должны быть тузами, масть значения не имеет.

Для начала найдем вероятность того, что первая карта будет тузом, для этого четыре делим на тридцать шесть. Отложили его в сторону. Достаем вторую карту, это будет туз с вероятностью три тридцать пятых. Вероятность второго события зависит от того, какую карту мы вытянули первой, нам интересно, был это туз или нет. Из этого следует, что событие В зависит от события А.

Следующим действием находим вероятность одновременного осуществления, то есть перемножаем А и В. Их произведение находится следующим образом: вероятность одного события умножаем на условную вероятность другого, которую мы вычисляем, предполагая, что первое событие произошло, то есть первой картой мы вытянули туз.

Для того чтобы стало все понятно, дадим обозначение такому элементу, как события. Вычисляется она, предполагая, что событие А произошло. Рассчитывается следующим образом: Р(В/А).

Продолжим решение нашей задачи: Р(А * В)=Р(А) * Р(В/А) или Р(А * В)=Р(В) * Р(А/В). Вероятность равняется (4/36) * ((3/35)/(4/36). Вычисляем, округляя до сотых. Мы имеем: 0,11 * (0,09/0,11)=0,11 * 0,82=0,09. Вероятность того, что мы вытянем два туза подряд, равна девяти сотым. Значение очень мало, из этого следует, что и вероятность происхождения события крайне мала.

Забытый номер

Предлагаем разобрать еще несколько вариантов заданий, которые изучает теория вероятности. Примеры решения некоторых из них вы уже видели в данной статье, попробуем решить следующую задачу: мальчик забыл последнюю цифру номера телефона своего друга, но так как звонок был очень важен, то начал набирать все по очереди. Нам необходимо вычислить вероятность того, что он позвонит не более трех раз. Решение задачи простейшее, если известны правила, законы и аксиомы теории вероятности.

Перед тем как смотреть решение, попробуйте решить самостоятельно. Нам известно, что последняя цифра может быть от нуля до девяти, то есть всего десять значений. Вероятность набрать нужную составляет 1/10.

Далее нам нужно рассматривать варианты происхождения события, предположим, что мальчик угадал и сразу набрал нужную, вероятность такого события равняется 1/10. Второй вариант: первый звонок промах, а второй в цель. Рассчитаем вероятность такого события: 9/10 умножаем на 1/9, в итоге получаем также 1/10. Третий вариант: первый и второй звонок оказались не по адресу, только с третьего мальчик попал туда, куда хотел. Вычисляем вероятность такого события: 9/10 умножаем на 8/9 и на 1/8, получаем в итоге 1/10. Другие варианты по условию задачи нас не интересуют, по этому нам осталось сложить полученные результаты, в итоге мы имеем 3/10. Ответ: вероятность того, что мальчик позвонит не более трех раз, равняется 0,3.

Карточки с числами

Перед вами девять карточек, на каждой из которых написано число от одного до девяти, цифры не повторяются. Их положили в коробку и тщательно перемешали. Вам необходимо рассчитать вероятность того, что

- выпадет четное число;

- двухзначное.

Перед тем как переходить к решению, оговорим, что m - это число удачных случаев, а n - это общее количество вариантов. Найдем вероятность того, что число будет четным. Не составит труда посчитать, что четных чисел четыре, это и будет наша m, всего возможно девять вариантов, то есть m=9. Тогда вероятность равняется 0,44 или 4/9.

Рассматриваем второй случай: количество вариантов девять, а удачных исходов быть вообще не может, то есть m равняется нулю. Вероятность того, что вытянутая карточка будет содержать двухзначное число, так же равняется нулю.

Теория вероятностей и математическая статистика

- Агекян Т.А. Основы теории ошибок для астрономов и физиков (2-е изд.). М.: Наука, 1972 (djvu , 2.44 M)

- Агекян Т.А. Теория вероятностей для астрономов и физиков. М.: Наука, 1974 (djvu , 2.59 M)

- Андерсон Т. Статистический анализ временных рядов. М.: Мир, 1976 (djvu , 14 M)

- Бакельман И.Я. Вернер А.Л. Кантор Б.Е. Введение в дифференциальную геометрию "в целом". М.: Наука, 1973 (djvu , 5.71 M)

- Бернштейн С.Н. Теория вероятностей. М.-Л.: ГИ, 1927 (djvu , 4.51 M)

- Биллингсли П. Сходимость вероятностных мер. М.: Наука, 1977 (djvu , 3.96 M)

- Бокс Дж. Дженкинс Г. Анализ временных рядов: прогноз и управление. Выпуск 1. М.: Мир, 1974 (djvu , 3.38 M)

- Бокс Дж. Дженкинс Г. Анализ временных рядов: прогноз и управление. Выпуск 2. М.: Мир, 1974 (djvu , 1.72 M)

- Борель Э. Вероятность и достоверность. М.: Наука, 1969 (djvu , 1.19 M)

- Ван дер Варден Б.Л. Математическая статистика. М.: ИЛ, 1960 (djvu , 6.90 M)

- Вапник В.Н. Восстановление зависимостей по эмпирическим данным. М.: Наука, 1979 (djvu , 6.18 M)

- Вентцель Е.С. Введение в исследование операций. М.: Советское радио, 1964 (djvu , 8.43 M)

- Вентцель Е.С. Элементы теории игр (2-е изд.). Серия: Популярные лекции по математике. Выпуск 32. М.: Наука, 1961 (djvu , 648 K)

- Венцтель Е.С. Теория вероятностей (4-е изд.). М.: Наука, 1969 (djvu , 8.05 M)

- Венцтель Е.С., Овчаров Л.А. Теория вероятностей. Задачи и упражнения. М.: Наука, 1969 (djvu , 7.71 M)

- Виленкин Н.Я., Потапов В.Г. Задачник-практикум по теории вероятностей с элементами комбинаторики и математической статистики. М.: Просвещение, 1979 (djvu , 1.12 M)

- Гмурман В.Е. Руководство к решению задач по теории вероятностей и математической статистике (3-е изд.). М.: Высш. шк., 1979 (djvu , 4.24 M)

- Гмурман В.Е. Теория вероятностей и математическая статистика (4-е изд.). М.: Высшая школа, 1972 (djvu , 3.75 M)

- Гнеденко Б.В., Колмогоров А.Н. Предельные распределения для сумм независимых случайных величин. М.-Л.: ГИТТЛ, 1949 (djvu , 6.26 M)

- Гнеденко Б.В., Хинчин А.Я. Элементарное введение в теорию вероятностей (7-е изд.). М.: Наука, 1970 (djvu , 2.48 M)

- Дуб Дж.Л. Вероятностные процессы. М.: ИЛ, 1956 (djvu , 8.48 M)

- Дэйвид Г. Порядковые статистики. М.: Наука, 1979 (djvu , 2.87 M)

- Ибрагимов И.А., Линник Ю.В. Независимые и стационарно связанные величины. М.: Наука, 1965 (djvu , 6.05 M)

- Идье В., Драйард Д., Джеймс Ф., Рус М., Садуле Б. Статистические методы в экспериментальной физике. М.: Атомиздат, 1976 (djvu , 5.95 M)

- Камалов М.К. Распределение квадратичных форм в выборках из нормальной совокупности. Ташкент: АН УзССР, 1958 (djvu , 6.29 M)

- Кассандрова О.Н., Лебедев В.В. Обработка результатов наблюдений. М.: Наука, 1970 (djvu , 867 K)

- Кац М. Вероятность и смежные вопросы в физике. М.: Мир, 1965 (djvu , 3.67 M)

- Кац М. Несколько вероятностных задач физики и математики. М.: Наука, 1967 (djvu , 1.50 M)

- Кац М. Статистическая независимость в теории вероятностей, анализе и теории чисел. М.: ИЛ, 1963 (djvu , 964 K)

- Кендалл М., Моран П. Геометрические вероятности. М.: Наука, 1972 (djvu , 1.40 M)

- Кендалл М., Стюарт А. Том 2. Статистические выводы и связи. М.: Наука, 1973 (djvu , 10 M)

- Кендалл М., Стюарт А. Том 3. Многомерный статистический анализ и временные ряды. М.: Наука, 1976 (djvu , 7.96 M)

- Кендалл М., Стюарт А. Том. 1. Теория распределений. М.: Наука, 1965 (djvu , 6.02 M)

- Колмогоров А.Н. Основные понятия теории вероятностей (2-е изд.) М.: Наука, 1974 (djvu , 2.14 M)

- Колчин В.Ф., Севастьянов Б.А., Чистяков В.П. Случайные размещения. М.: Наука, 1976 (djvu , 2.96 M)

- Крамер Г. Математические методы статистики (2-е изд.). М.: Мир, 1976 (djvu , 9.63 M)

- Леман Э. Проверка статистических гипотез. М.: Наука. 1979 (djvu , 5.18 M)

- Линник Ю.В., Островский И.В. Разложения случайных величин и векторов. М.: Наука, 1972 (djvu , 4.86 M)

- Лихолетов И.И., Мацкевич И.П. Руководство к решению задач по высшей математике, теории вероятностей и математической статистике (2-е изд.). Мн.: Выш. школа, 1969 (djvu , 4.99 M)

- Лоэв М. Теория вероятностей. М.: ИЛ, 1962 (djvu , 7.38 M)

- Малахов А.Н. Кумулянтный анализ случайных негауссовых процессов и их преобразований. М.: Сов. радио, 1978 (djvu , 6.72 M)

- Мешалкин Л.Д. Сборник задач по теории вероятностей. М.: МГУ, 1963 (djvu , 1 004 K)

- Митропольский А.К. Теория моментов. М.-Л.: ГИКСЛ, 1933 (djvu , 4.49 M)

- Митропольский А.К. Техника статистических вычислений (2-е изд.). М.: Наука, 1971 (djvu , 8.35 M)

- Мостеллер Ф., Рурке Р., Томас Дж. Вероятность. М.: Мир, 1969 (djvu , 4.82 M)

- Налимов В.В. Применение математической статистики при анализе вещества. М.: ГИФМЛ, 1960 (djvu , 4.11 M)

- Невё Ж. Математические основы теории вероятностей. М.: Мир, 1969 (djvu , 3.62 M)

- Престон К. Математика. Новое в зарубежной науке No.7. Гиббсовские состояния на счетных множествах. М.: Мир, 1977 (djvu , 2.15 M)

- Савельев Л.Я. Элементарная теория вероятностей. Часть 1. Новосибирск: НГУ, 2005 (

для студентов 2 курса всех специальностей

Кафедра Высшей математики

Вводная часть

Уважаемые студенты!

Вашему вниманию предлагается обзорная (установочная) лекция профессора Н.Ш.Кремера по дисциплине «Теория вероятностей и математическая статистика» для студентов второго курса ВЗФЭИ.

В лекции обсуждаются задачи изучения теории вероятностей и математической статистики в экономическом вузе и ее место в системе подготовки современного экономиста, рассматривается организация самостоятельной работы студентов с использованием компьютерной обучающей системы (КОПР) и традиционных учебников, даются обзор основных положений данного курса, а также методические рекомендации по ее изучению.

Среди математических дисциплин, изучаемых в экономическом вузе, теория вероятностей и математическая статистика занимает особое положение. Во-первых, она является теоретической базой статистических дисциплин. Во-вторых, методы теории вероятностей и математической статистики непосредственно используются при изучении массовых совокупностей наблюдаемых явлений, обработке результатов наблюдений и выявлении закономерностей случайных явлений. Наконец, теория вероятностей и математическая статистика имеет важное методологическое значение в познавательном процессе , при выявлении общей закономерности исследуемых процессов, служит логической основой индуктивно-дедуктивного умозаключения.

Каждый студент второго курса должен иметь следующий набор (кейс) по дисциплине «Теория вероятностей и математическая статистика»:

1. Обзорную установочную лекцию по данной дисциплине.

2. Учебник Н.Ш. Кремера «Теория вероятностей и математическая статистика» – М.: ЮНИТИ – ДАНА, 2007 (в дальнейшем будем называть просто «учебник»).

3. Учебно-методическое пособие «Теория вероятностей и математическая статистика»/ под ред. Н.Ш. Кремера. – М.: Вузовский учебник, 2005 (в дальнейшем «пособие»).

4. Компьютерную обучающую программу КОПР по дисциплине (в дальнейшем – «компьютерная программа»).

На сайте института на странице «Корпоративные ресурсы» размещены интернет-версии компьютерной программы КОПР2, обзорной установочной лекции и электронной версии пособия. Кроме того, компьютерная программа и пособие представлены на CD - ROM ах для студентов второго курса. Поэтому в «бумажном виде» студенту необходимо иметь лишь учебник.

Поясним назначение каждого из учебно-методических материалов, входящий в указанный набор (кейс).

В учебнике изложены основные положения учебного материала дисциплины, иллюстрируемые достаточно большим числом решенных задач.

В пособии даны методические рекомендации по самостоятельному изучению учебного материала, выделены наиболее важные понятия курса и типовые задачи, даны контрольные вопросы для самопроверки по данной дисциплине, приведены варианты домашних контрольных работ, которые должен выполнить студент, а также методические указания по их выполнению.

Компьютерная программа призвана оказать Вам максимальную помощь в усвоении курса в режиме диалога программы со студентом с тем, чтобы в наибольшей степени восполнить отсутствие у Вас аудиторных занятий, соответствующего контакта с преподавателем.

Для студента, обучающегося по системе дистанционного обучения, первостепенное, определяющее значение имеет организация самостоятельной работы.

Приступая к изучению данной дисциплины, прочтитедо конца настоящую обзорную (установочную) лекцию. Это позволит Вам получить в целом представление об основных понятиях и методах, используемых в курсе «Теория вероятностей и математическая статистика», и требованиях, предъявляемых к уровню подготовки студентов ВЗФЭИ.

Перед изучением каждой темы ознакомьтесь с методическими рекомендациями к изучению данной темы по пособию. Здесь Вы найдете перечень учебных вопросов данной темы, которые Вам предстоит изучить; выясните, какие понятия, определения, теоремы, задачи являются наиболее важными, которые надо изучить и освоить в первую очередь.

Затем перейдите к изучению основного учебного материала по учебнику в соответствии с полученными методическими рекомендациями. Советуем конспектировать в отдельной тетради основные определения, формулировки теорем, схемы их доказательств, формулы и решения типовых задач. Формулы целесообразно выписывать в специальные таблицы для каждой части курса: теория вероятностей и математическая статистика. Регулярное пользование конспектом, в частности, таблицами формул, способствует их запоминанию.

Лишь после проработки основного учебного материала каждой темы по учебнику можно перейти к изучению этой темы с помощью компьютерной обучающей программы (КОПР2).

Обратите внимание на структуру построения компьютерной программы по каждой теме. После названия темы приводится перечень основных учебных вопросов темы по учебнику с указанием номеров параграфов и страниц, которые необходимо изучить. (Напомним, что перечень этих вопросов по каждой теме приведен также и в пособии).

Затем в краткой форме дается справочный материал по данной теме (или по отдельным параграфам этой темы) – основные определения, теоремы, свойства и признаки, формулы и т.п. В процессе изучения темы Вы также можете вызвать на экран те фрагменты справочного материала (по данной или предыдущим темам), которые необходимы в данный момент.

Затем Вам предлагается учебный материал и обязательно типовые задачи (примеры), решение которых рассматривается в режиме диалога программы со студентом. Функции ряда примеров ограничиваются выводом на экран по запросу обучаемого этапов правильного решения. Вместе с тем в процессе рассмотрения большинства примеров Вам будут задаваться вопросы того или иного характера. В качестве ответов на одни вопросы следует вводить с клавиатуры числовой ответ, на другие – выбирать правильный ответ (или ответы) из нескольких предложенных.

В зависимости от введенного Вами ответа программа подтверждает его правильность или предлагает, ознакомившись с подсказкой, содержащей необходимые теоретические положения, вновь попытаться дать правильные решение и ответ. Во многих заданиях установлено ограничение на количество попыток решения (при превышении этого ограничения на экран обязательно выводится правильный ход решения). Имеются и такие примеры, в которых количество информации, содержащееся в подсказке, возрастает по мере повторения неудачных попыток ответа.

После ознакомления с теоретическими положениями учебного материала и примерами, которые снабжены подробным разбором решения, Вы должны выполнить упражнения для самоконтроля, чтобы закрепить навыки решения типовых задач по каждой теме. Задания для самоконтроля также содержат элементы диалога со студентом. По завершению решения Вы можете ознакомиться с правильным ответом и сравнить его с тем, который Вы дали.

В завершение работы по каждой теме следует выполнить контрольные задания. Правильные ответы на них Вам не выводятся, а Ваши ответы записываются на жесткий диск компьютера для последующего ознакомления с ними преподавателя-консультанта (тьютора).

После изучения тем 1–7 Вы должны выполнить домашнюю контрольную работу № 3, а после изучения тем 8–11 – домашнюю контрольную работу № 4. Варианты указанных контрольных работ приведены в пособии (его электронной версии). Номер выполняемого варианта должен совпадать с последней цифрой номера Вашего личного дела (зачетной книжки, студенческого билета). По каждой контрольной работе Вы должны проходить собеседование, на котором необходимо показать умение решать задачи и знание основных понятий (определений, теорем (без доказательства), формул и т.п.) по теме контрольной работы. Завершается изучение дисциплины курсовым экзаменом.

Теория вероятностей – математическая наука, изучающая закономерности случайных явлений.

Предлагаемая для изучения дисциплина состоит из двух разделов «Теория вероятностей» и «Математическая статистика».

Теория вероятностей и математическая статистика

1.ТЕОРЕТИЧЕСКАЯ ЧАСТЬ

1 Сходимость последовательностей случайных величин и вероятностных распределений

В теории вероятностей приходится иметь дело с разными видами сходимости случайных величин. Рассмотрим следующие основные виды сходимости: по вероятности, с вероятностью единица, среднем порядка р, по распределению.

Пусть, … - случайные величины, заданные на некотором вероятностном пространстве (, Ф, P).

Определение 1. Последовательность случайных величин, … называется сходящейся по вероятности к случайной величине (обозначение:), если для любого > 0

Определение 2. Последовательность случайных величин, … называется сходящейся с вероятностью единица (почти наверное, почти всюду) к случайной величине, если

т.е. если множество исходов, для которых () не сходятся к (), имеет нулевую вероятность.

Этот вид сходимости обозначают следующим образом: , или, или.

Определение 3. Последовательность случайных величин, … называется сходящейся в среднем порядка р, 0 < p < , если

Определение 4. Последовательность случайных величин,… называется сходящейся по распределению к случайной величине (обозначение:), если для любой ограниченной непрерывной функции

Сходимость по распределению случайных величин определяется только в терминах сходимости их функций распределения. Поэтому об этом виде сходимости имеет смысл говорить и тогда, когда случайные величины заданы на разных вероятностных пространствах.

Теорема 1.

а) Для того чтобы (Р-п.н.), необходимо и достаточно, чтобы для любого > 0

) Последовательность {} фундаментальна с вероятностью единица тогда и только тогда, когда для любого > 0.

Доказательство.

а) Пусть А = {: |- | }, А= А. Тогда

Поэтому утверждение а) является результатом следующей цепочки импликаций:

Р{: }= 0 P() = 0 = 0 Р(А) = 0, m 1 P(A) = 0, > 0 P() 0, n 0, > 0 P{ } 0,

n 0, > 0.) Обозначим = {: }, = . Тогда {: {()} не фундаментальна } = и так же, как в а) показывается, что {: {()} не фундаментальна } = 0 P{ } 0, n.

Теорема доказана

Теорема 2. (критерий Коши сходимости почти наверно)

Для того чтобы последовательность случайных величин {} была сходящейся с вероятностью единица (к некоторой случайной величине), необходимо и достаточно, чтобы она была фундаментальна с вероятностью единица.

Доказательство.

Если, то +

откуда вытекает необходимость условия теоремы.

Пусть теперь последовательность {} фундаментальна с вероятностью единица. Обозначим L = {: {()} не фундаментальная}. Тогда для всех числовая последовательность {} является фундаментальной и, согласно критерию Коши для числовых последовательностей, существует (). Положим

Так определенная функция является случайной величиной и.

Теорема доказана.

2 Метод характеристических функций

Метод характеристических функций является одним из основных средств аналитического аппарата теории вероятностей. Наряду со случайными величинами (принимающими действительные значения) теория характеристических функций требует привлечения комплекснозначных случайных величин.

Многие из определений и свойств, относящихся к случайным величинам, легко переносятся и на комплексный случай. Так, математическое ожидание М? комплекснозначной случайной величины ?=?+?? считается определенным, если определены математические ожидания М? и М?. В этом случае по определению полагаем М? = М? + ?М?. Из определения независимости случайных элементов следует, что комплекснозначные величины ?1 =?1+??1 , ?2=?2+??2 независимы тогда и только тогда, когда независимы пары случайных величин (?1 , ?1) и (?2 , ?2), или, что то же самое, независимы ?-алгебры F?1, ?1 и F?2, ?2.

Наряду с пространством L2 действительных случайных величин с конечным вторым моментом можно ввести в рассмотрение гильбертово пространство комплекснозначных случайных величин ?=?+?? с М |?|2?|2= ?2+?2, и скалярным произведением (?1 , ?2)= М?1?2¯, где ?2¯- комплексно-сопряженная случайная величина.

При алгебраических операциях векторы Rn рассматриваются как алгебраические столбцы,

Как вектор-строки, a* - (а1,а2,…,аn). Если Rn , то под их скалярным произведением (a,b) будет пониматься величина. Ясно, что

Если аRn и R=||rij|| - матрица порядка nхn, то

Определение 1. Пусть F = F(х1,….,хn) - n-мерная функция распределения в (, ()). Ее характеристической функцией называется функция

Определение 2. Если? = (?1,…,?n) - случайный вектор, определенный на вероятностном пространстве со значениями в, то его характеристической функцией называется функция

где F? = F?(х1,….,хn) - функция распределения вектора?=(?1, … , ?n).

Если функция распределения F(х) имеет плотность f = f(х), то тогда

В этом случае характеристическая функция есть не что иное, как преобразование Фурье функции f(x).

Из (3) вытекает, что характеристическую функцию??(t) случайного вектора можно определить также равенством

Основные свойства характеристических функций (в случае n=1).

Пусть? = ?(?) - случайная величина, F? = F? (х) - её функция распределения и - характеристическая функция.

Следует отметить, что если, то.

В самом деле,

где воспользовались тем, что математическое ожидание произведения независимых (ограниченных) случайных величин равно произведению их математических ожиданий.

Свойство (6) является ключевым при доказательстве предельных теорем для сумм независимых случайных величин методом характеристических функций. В этой связи, функция распределения выражается через функции распределения отдельных слагаемых уже значительно более сложным образом, а именно, где знак * означает свертку распределений.

С каждой функцией распределения в можно связать случайную величину, имеющую эту функцию в качестве своей функции распределения. Поэтому при изложении свойств характеристических функций можно ограничиться рассмотрением характеристических функций случайных величин.

Теорема 1. Пусть? - случайная величина с функцией распределения F=F(х) и - ее характеристическая функция.

Имеют место следующие свойства:

) равномерно непрерывна по;

) является действительнозначной функцией тогда и только тогда, когда распределение F симметрично

)если для некоторого n ? 1 , то при всех существуют производные и

)Если существует и является конечной, то

)Пусть для всех n ? 1 и

тогда при всех |t| Следующая теорема показывает, что характеристическая функция однозначно определяет функцию распределения. Теорема 2 (единственности). Пусть F и G - две функции распределения, имеющие одну и ту же характеристическую функцию, то есть для всех Теорема говорит о том, что функция распределения F = F(х) однозначно восстанавливается по своей характеристической функции. Следующая теорема дает явное представление функции F через. Теорема 3 (формула обобщения). Пусть F = F(х) - функция распределения и - ее характеристическая функция. а) Для любых двух точек a, b (a < b), где функция F = F(х) непрерывна, ) Если то функция распределения F(х) имеет плотность f(x), Теорема 4. Для того чтобы компоненты случайного вектора были независимы, необходимо и достаточно, чтобы его характеристическая функция была произведением характеристических функций компонент: Теорема Бохнера-Хинчина.

Пусть - непрерывная функция, Для того, чтобы была характеристической, необходимо и достаточно, чтобы она была неотрицательно-определенной, то есть для любых действительных t1, … , tn и любых комплексных чисел Теорема 5. Пусть - характеристическая функция случайной величины. а) Если для некоторого, то случайная величина является решетчатой с шагом, то есть ) Если для двух различных точек, где - иррациональное число, то случайная величина? является вырожденной: где а - некоторая константа. с) Если, то случайная величина? вырождена. 1.3 Центральная предельная теорема для независимых одинаково распределенных случайных величин Пусть {} - последовательность независимых, одинаково распределенных случайных величин. Математическое ожидание M= a, дисперсия D= , S = , а Ф(х) - функция распределения нормального закона с параметрами (0,1). Введем еще последовательность случайных величин Теорема. Если 0 <<, то при n P(< x) Ф(х) равномерно относительно х (). В этом случае последовательность {} называется асимптотически нормальной. Из того, что М= 1 и из теорем непрерывности вытекает, что наряду со слабой сходимостью, ФМ f() Mf() для любой непрерывной ограниченной f имеет место также сходимость М f() Mf() для любой непрерывной f, такой, что |f(x)| < c(1+|x|) при каком-нибудь. Доказательство. Равномерная сходимость здесь является следствием слабой сходимости и непрерывности Ф(х). Далее, без ограничения общности можно считать а = 0, так как иначе можно было бы рассмотреть последовательность {}, при этом последовательность {} не изменилась бы. Стало быть, для доказательства требуемой сходимости достаточно показать, что (t) e,когда а = 0. Имеем (t) = , где =(t). Так как существует М, то существует и справедливо разложение Следовательно, при n Теорема доказана. 1.4 Основные задачи математической статистики их краткая характеристика Установление закономерностей, которым подчинены массовые случайные явления, основано на изучении статистических данных - результатах наблюдений. Первая задача математической статистики - указать способы сбора и группировки статистических сведений. Вторая задача математической статистики - разработать методы анализа статистических данных, в зависимости от целей исследования. При решении любой задачи математической статистики располагают двумя источниками информации. Первый и наиболее определенный(явный) - это результат наблюдений (эксперимента) в виде выборки из некоторой генеральной совокупности скалярной или векторной случайной величины. При этом объем выборки n может быть фиксирован, а может и увеличиваться в ходе эксперимента (т. е. могут использоваться так называемые последовательные процедуры статистического анализа). Второй источник - это вся априорная информация об интересующих свойствах изучаемого объекта, которая накоплена к текущему моменту. Формально объем априорной информации отражается в той исходной статистической модели, которую выбирают при решении задачи. Однако и о приближенном в обычном смысле определении вероятности события по результатам опытов говорить не приходится. Под приближенным определением какой-либо величины обычно подразумевают, что можно указать пределы погрешностей, из которых ошибка не выйдет. Частота же события случайна при любом числе опытов из-за случайности результатов отдельных опытов. Из-за случайности результатов отдельных опытов частота может значительно отклоняться от вероятности события. Поэтому, определяя неизвестную вероятность события как частоту этого события при большом числе опытов, не можем указать пределы погрешности и гарантировать, что ошибка не выйдет из этих пределов. Поэтому в математической статистике обычно говорят не о приближенных значениях неизвестных величин, а об их подходящих значениях, оценках. Задача оценивания неизвестных параметров возникает в тех случаях, когда функция распределения генеральной совокупности известна с точностью до параметра. В этом случае необходимо найти такую статистику, выборочное значение которой для рассматриваемой реализации xn случайной выборки можно было бы считать приближенным значением параметра. Статистику, выборочное значение которой для любой реализации xn принимают за приближенное значение неизвестного параметра, называют его точечной оценкой или просто оценкой, а - значением точечной оценки. Точечная оценка должна удовлетворять вполне определенным требованиям для того, чтобы её выборочное значение соответствовало истинному значению параметра. Возможным является и иной подход к решению рассматриваемой задачи: найти такие статистики и,чтобы с вероятностью? выполнялось неравенство: В этом случае говорят об интервальной оценке для. Интервал называют доверительным интервалом для с коэффициентом доверия?. Оценив по результатам опытов ту или иную статистическую характеристику, возникает вопрос: насколько согласуется с опытными данными предположение (гипотеза) о том, что неизвестная характеристика имеет именно то значение, которое получено в результате её оценивания? Так возникает второй важный класс задач математической статистики - задачи проверки гипотез. В некотором смысле задача проверки статистической гипотезы является обратной к задаче оценивания параметра. При оценивании параметра мы ничего не знаем о его истинном значении. При проверке статистической гипотезы из каких-то соображений предполагается известным его значение и необходимо по результатам эксперимента проверить данное предположение. Во многих задачах математической статистики рассматриваются последовательности случайных величин, сходящиеся в том или ином смысле к некоторому пределу (случайной величине или константе), когда. Таким образом, основными задачами математической статистики являются разработка методов нахождения оценок и исследования точности их приближения к оцениваемым характеристикам и разработка методов проверки гипотез. 5 Проверка статистических гипотез: основные понятия Задача разработки рациональных методов проверки статистических гипотез - одна из основных задач математической статистики. Статистической гипотезой (или просто гипотезой) называют любое утверждение о виде или свойствах распределения наблюдаемых в эксперименте случайных величин. Пусть имеется выборка, являющаяся реализацией случайной выборки из генеральной совокупности, плотность распределения которой зависит от неизвестного параметра. Статистические гипотезы относительно неизвестного истинного значения параметра называют параметрическими гипотезами. При этом если - скаляр, то речь идет об однопараметрических гипотезах, а если вектор - то о многопараметрических гипотезах. Статистическую гипотезу называют простой, если она имеет вид где - некоторое заданное значение параметра. Статистическую гипотезу называют сложной, если она имеет вид где - некоторое множество значений параметра, состоящее более чем из одного элемента. В случае проверки двух простых статистических гипотез вида где - два заданных (различных) значения параметра, первую гипотезу обычно называют основной, а вторую - альтернативной, или конкурирующей гипотезой. Критерием, или статистическим критерием, проверки гипотез называют правило, по которому по данным выборки принимается решение о справедливости либо первой, либо второй гипотезы. Критерий задают с помощью критического множества, являющегося подмножеством выборочного пространства случайной выборки. Решение принимают следующим образом: )если выборка принадлежит критическому множеству, то отвергают основную гипотезу и принимают альтернативную гипотезу; )если выборка не принадлежит критическому множеству (т. е. принадлежит дополнению множества до выборочного пространства), то отвергают альтернативную гипотезу и принимают основную гипотезу. При использовании любого критерия возможны ошибки следующих видов: 1)принять гипотезу, когда верна - ошибка первого рода; )принять гипотезу, когда верна - ошибка второго рода. Вероятности совершения ошибок первого и второго рода обозначают и: где - вероятность события при условии, что справедлива гипотеза Указанные вероятности вычисляют с использованием функции плотности распределения случайной выборки: Вероятность совершения ошибки первого рода также называют уровнем значимости критерия. Величину, равную вероятности отвергнуть основную гипотезу, когда она верна, называют мощностью критерия. 1.6 Критерий независимости Имеется выборка ((XY), …, (XY)) из двумерного распределения L с неизвестной функцией распределения, для которой требуется проверить гипотезу H: , где некоторые одномерные функции распределения. Простой критерий согласия для гипотезы H можно построить, основываясь на методике. Эту методику применяют для дискретных моделей с конечным числом исходов, поэтому условимся считать, что случайная величина принимает конечное число s некоторых значений, которые будем обозначать буквами, а вторая компонента - k значений. Если исходная модель имеет другую структуру, то предварительно группируют возможные значения случайных величин отдельно по первой и второй компонентам. В этом случае множество разбивается на s интервалов, множество значение - на k интервалов, а само множество значений - на N=sk прямоугольников. Обозначим через число наблюдений пары (число элементов выборки, принадлежащих прямоугольнику, если данные группируются), так что. Результаты наблюдений удобно расположить в виде таблицы сопряженности двух знаков(табл. 1.1) . В приложениях и обычно означают два признака, по которым производится классификация результатов наблюдения. Пусть Р, i=1,…,s, j=1,…,k. Тогда гипотеза независимости означает, что существует s+k постоянных таких, что и, т.е. Таблица 1.1 Сумма. . .. . .. . . . . .. . .. . . . . . . . . . . . . . .Сумма. . .n

Таким образом, гипотеза H сводится к утверждению, что частоты (число их равно N = sk) распределены по полиномиальному закону с вероятностями исходов, имеющими указанную специфическую структуру (вектор вероятностей исходов р определяется значениями r=s+k-2 неизвестных параметров. Для проверки этой гипотезы, найдем оценки максимального правдоподобия для определяющих рассматриваемую схему неизвестных параметров. Если справедлива нулевая гипотеза, то функция правдоподобия имеет вид L(p)= где множитель с от неизвестных параметров не зависит. Отсюда по методу неопределенных множителей Лагранжа получаем, что искомые оценки имеют вид Следовательно, статистика L() при, поскольку число степеней свободы в предельном распределении равно N-1-r=sk-1-(s+k-2)=(s-1)(k-1). Итак, при достаточно больших n можно использовать следующее правило проверки гипотезы: гипотезу Н отвергают тогда и только тогда, когда вычисленное по фактическим данным значение t статистики удовлетворяет неравенству Этот критерий имеет асимптотически (при) заданный уровень значимости и называется критерием независимости. 2. ПРАКТИЧЕСКАЯ ЧАСТЬ 1 Решения задач о типах сходимости 1. Доказать, что из сходимости почти наверное следует сходимость по вероятности. Приведите контрольный пример, показывающий, что обратное утверждение неверно. Решение. Пусть последовательность случайных величин сходится к случайной величине x почти наверное. Значит, для любого? > 0 Так как, то и из сходимости xn к x почти наверное вытекает, что xn сходится к x по вероятности, так как в этом случае Но обратное утверждение не верно. Пусть - последовательность независимых случайных величин, имеющих одну и ту же функцию распределения F(x), равную нулю при х? 0 и равную при х > 0. Рассмотрим последовательность Эта последовательность сходится к нулю по вероятности, так как стремится к нулю при любом фиксированном? и. Однако сходимость к нулю почти наверное иметь место не будет. Действительно стремится к единице, то есть с вероятностью 1 при любых и n в последовательности найдутся реализации, превосходящие?. Отметим, что при наличии некоторых дополнительных условий, накладываемых на величины xn, сходимость по вероятности влечет сходимость почти наверное. Пусть xn - монотонная последовательность. Доказать, что в этом случае сходимость xn к x по вероятности влечет за собой сходимость xn к x с вероятностью 1. Решение. Пусть xn - монотонно убывающая последовательность, то есть. Для упрощения наших рассуждений будем считать, что x º 0, xn ³ 0 при всех n. Пусть xn сходится к x по вероятности, однако сходимость почти наверное не имеет место. Тогда существует? > 0, такое, что при всех n Но и сказанное означает, что при всех n что противоречит сходимости xn к x по вероятности. Таким образом, для монотонной последовательности xn, сходящийся к x по вероятности, имеет место и сходимость с вероятностью 1 (почти наверное). Пусть последовательность xn сходится к x по вероятности. Доказать, что из этой последовательности можно выделить последовательность, сходящуюся к x с вероятностью 1 при. Решение. Пусть - некоторая последовательность положительных чисел, причем, и - такие положительные числа, что ряд. Построим последовательность индексов n1 Тогда ряд Так как ряд сходится, то при любом? > 0 остаток ряда стремится к нулю. Но тогда стремится к нулю и Доказать, что из сходимости в среднем какого либо положительного порядка следует сходимость по вероятности. Приведите пример, показывающий, что обратное утверждение неверно. Решение. Пусть последовательность xn сходится к величине x в среднем порядка р > 0, то есть Воспользуемся обобщенным неравенством Чебышева: для произвольных? > 0 и р > 0 Устремив и учитывая, что, получим, что то есть xn сходится к x по вероятности. Однако сходимость по вероятности не влечет за собой сходимость в среднем порядка р > 0. Это показывает следующий пример. Рассмотрим вероятностное пространство áW, F , Rñ, где F = B - борелевская s-алгебра, R - мера Лебега. Определим последовательность случайных величин следующим образом: Последовательность xn сходится к 0 по вероятности, так как но при любом р > 0 то есть сходимость в среднем иметь не будет. Пусть, при чем для всех n . Доказать, что в этом случае xn сходится к x в среднеквадратическом. Решение. Заметим, то и. Получим оценку для. Рассмотрим случайную величину. Пусть? - произвольное положительное число. Тогда при и при. Если, то и. Следовательно, . А поскольку? сколь угодно мало и, то при, то есть в среднеквадратическом. Доказать, что если xn сходится к x по вероятности, то имеет место слабая сходимость. Приведите контрольный пример, показывающий, что обратное утверждение неверно. Решение. Докажем, что если, то в каждой точке х, являющейся точкой непрерывности (это необходимое и достаточное условие слабой сходимости), - функция распределения величины xn, а - величины x. Пусть х - точка непрерывности функции F. Если, то справедливо по крайней мере одно из неравенств или. Тогда Аналогично, при справедливо хотя бы одно из неравенств или и Если, то для сколь угодно малого? > 0 существует такое N, что при всех п > N С другой стороны, если х - точка непрерывности то можно найти такое? > 0, что для сколь угодно малого Значит, для сколь угодно малых? и существует такое N, что при п >N или, что то же самое, Это означает, что во всех точках непрерывности имеет место сходимость и. Следовательно, из сходимости по вероятности вытекает слабая сходимость. Обратное утверждение, вообще говоря, не имеет места. Чтобы убедиться в этом, возьмем последовательность случайных величин, не равных с вероятностью 1 постоянным и имеющих одну и ту же функцию распределения F(x). Считаем, что при всех п величины и независимы. Очевидно, слабая сходимость имеет место, так как у всех членов последовательности одна и та же функция распределения. Рассмотрим: |Из независимости и одинаковой распределенности величин, следует, что Выберем среди всех функций распределений невырожденных случайных величин такую F(x), что будет отлично от нуля при всех достаточно малых?. Тогда не стремится к нулю при неограниченном росте п и сходимость по вероятности иметь место не будет. 7. Пусть имеет место слабая сходимость, где с вероятностью 1 есть постоянная. Доказать, что в этом случае будет сходиться к по вероятности. Решение. Пусть с вероятностью 1 равно а. Тогда слабая сходимость означает сходимость при любых. Так как, то при и при. То есть при и при. Отсюда следует, что для любого? > 0 вероятности стремятся к нулю при. Это значит, что стремится к нулю при, то есть сходиться к по вероятности. 2.2 Решение задач на ЦПТ Значение гамма-функции Г(x) при x= вычисляется методом Монте-Карло. Найдем минимальное число испытаний необходимых для того, что бы с вероятностью 0,95 можно было ожидать, что относительная погрешность вычислений будет меньше одного процента. Для с точностью до имеем Известно, что Сделав в (1) замену, приходим к интегралу по конечному промежутку: У нас, поэтому Как видно, представимо в виде, где, а распределена равномерно на. Пусть произведено статистических испытаний. Тогда статистическим аналогом является величина где, - независимые случайные величины с равномерным на распределением. При этом Из ЦПТ следует, что асимптотически нормальна с параметрами. Значит, минимальное количество испытаний, обеспечивающее с вероятностью относительную погрешность вычисления не более равно. Рассматривается последовательность из 2000 независимых одинаково распределенных случайных величин с математическим ожиданием, равным 4, и дисперсией, равной 1,8. Среднее арифметическое этих величин есть случайная величина. Определить вероятность того, что случайная величина примет значение в интервале (3,94; 4,12). Пусть, …,…- последовательность независимых случайных величин, имеющих одинаковое распределение с M=a=4 и D==1,8. Тогда к последовательности {} применима ЦПТ. Случайная величина Вероятность того, что примет значение в интервале (): При n=2000, 3,94 и 4,12 получим 3 Проверка гипотез критерием независимости В результате проведенного исследования было установлено, что у 782 светлоглазых отцов сыновья тоже имеют светлые глаза, а 89 светлоглазых отцов сыновья - темноглазые. У 50 темноглазых отцов сыновья также темноглазые, а у 79 темноглазых отцов сыновья - светлоглазые. Имеется ли зависимость между цветом глаз отцов и цветом глаз их сыновей? Уровень доверия принять равным 0,99. Таблица 2.1 ДетиОтцыСуммаСветлоглазыеТемноглазыеСветлоглазые78279861Темноглазые8950139Сумма8711291000 H: нет зависимости между цветом глаз детей и отцов. H: есть зависимость между цветом глаз детей и отцов. s=k=2 =90,6052 с 1 ступеней свободы Вычисление сделаны в программе Mathematica 6. Поскольку > , то гипотезу H, про отсутствия зависимости между цветом глаз отцов и детей, при уровне значимости, следует отклонить и принять альтернативную гипотезу H. Утверждается, что результат действия лекарства зависит от способа применения. Проверьте это утверждение по данным, представленным в табл. 2.2 Уровень доверия принять равным 0,95. Таблица 2.2 РезультатСпособ примененияАВСНеблагоприятный111716Благоприятный202319 Решение.

Для решения данной задачи воспользуемся таблицей сопряженности двух признаков. Таблица 2.3 РезультатСпособ примененияСуммаАВСНеблагоприятный11171644Благоприятный20231962Сумма314035106 H: результат действия лекарств не зависит от способа применения H: результат действия лекарств зависит от способа применения Статистика вычисляется за следующей формулой s=2, k=3, =0,734626 c 2 ступенями свободы. Вычисление сделаны в программе Mathematica 6 По таблицам распределения находим, что. Поскольку < , то гипотезу H, про отсутствия зависимости действия лекарств от способа применения, при уровне значимости, следует принять. Заключение В данной работе приведены теоретические выкладки из раздела «Критерий независимости », а также «Предельные теоремы теории вероятностей», курсу «Теория вероятностей и математическая статистика». В ходе выполнения работы на практике были проверены критерий независимости; также для заданных последовательностей независимых случайных величин было проверено выполнение центральной предельной теоремы. Данная работа помогла усовершенствовать мои знания с данных разделов теории вероятностей, работы с литературными источниками, твердо владеть техникой проверки критерия независимости. вероятностная статистическая гипотеза теорема Перечень ссылок 1. Сборник задач с теории вероятности с решением. Уч. пособие / Под ред. В.В. Семенца. - Харьков: ХТУРЕ, 2000. - 320с. Гихман И.И., Скороход А.В., Ядренко М.И. Теория вероятностей и математическая статистика. - К.: Вища шк., 1979. - 408 с. Ивченко Г.И., Медведев Ю.И., Математическая статистика: Учеб. пособие для втузов. - М.: Высш. шк., 1984. - 248с., . Математическая статистика: Учеб. для вузов/ В.Б. Горяинов, И.В. Павлов, Г.М. Цветкова и др.; Под ред. В.С. Зарубина, А.П. Крищенко. - М.: Изд-во МГТУ им. Н.Э. Баумана, 2001. - 424с. Нужна помощь по изучению какой-либы темы?

Наши специалисты проконсультируют или окажут репетиторские услуги по интересующей вас тематике.Репетиторство

Отправь заявку

с указанием темы прямо сейчас, чтобы узнать о возможности получения консультации.